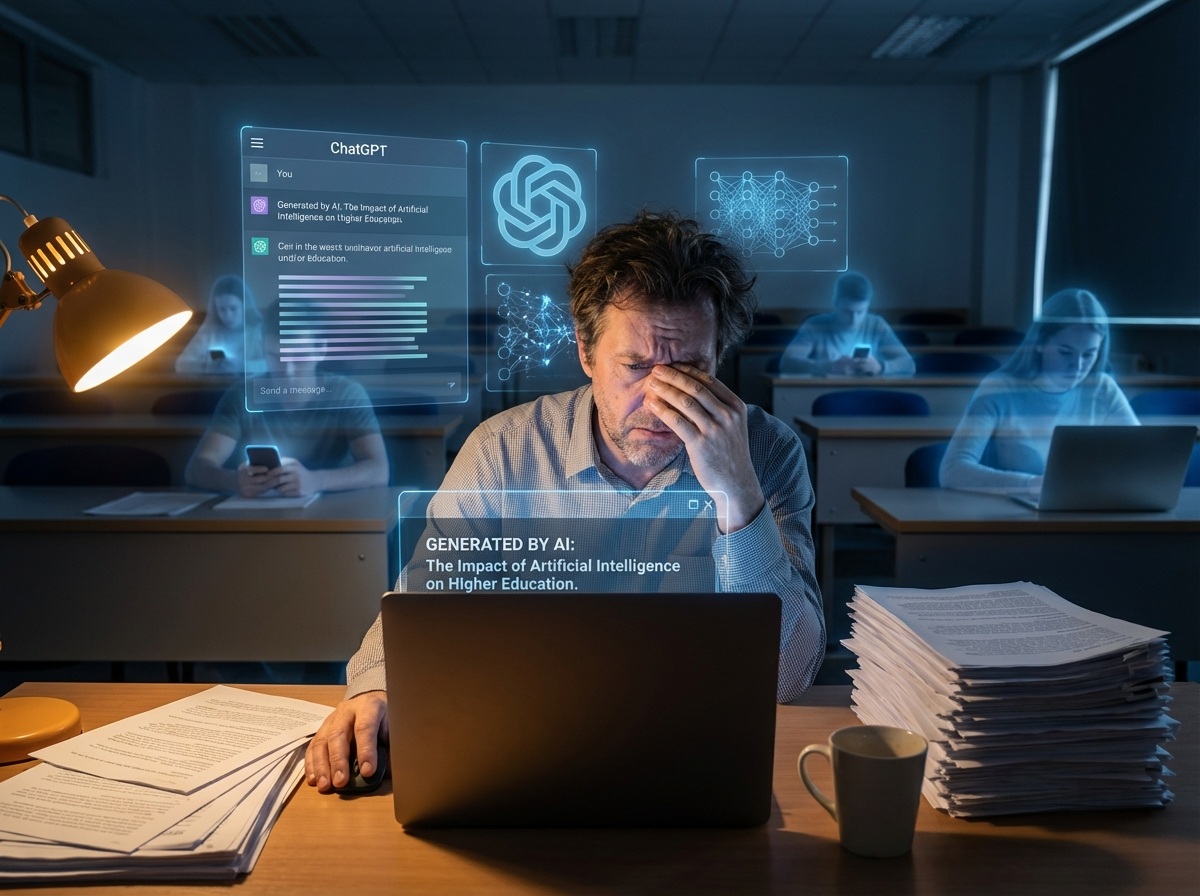

在 ChatGPT 时代教书,就是体会痛苦

#IAICA观察 时间2026-04-16 10:48:57

IAICA.com.cn · arstechnica.com · 2026.04.16 · 作者:斯科特·K·约翰逊(美)

作为一名大学教师,我遇到的最令人沮丧的问题是法学硕士的使用

我兼职教大学地球科学课程已经很久了,同时还兼顾其他工作。我当初选择这份工作是因为我喜欢它;没人会因为众所周知的低薪和毫无保障的工作而选择它。和学生们一起工作是一种真正令人满足的体验,它如此令人着迷,以至于应该提醒人们注意这一点。

但由于生成式人工智能的出现,这种情况大多变得很糟糕——至少在某些情况下是这样。

过去几年,我一直专注于教授异步在线课程,也就是录制视频而不是直播课程。这类课程总是比面授课程更具挑战性,因为面授课程中,老师更容易引导学生跟上进度。如果学生不必在预定时间到教室待上一个小时,而且没人能看到他们不理解时脸上流露出的表情,那么他们很容易就会……掉线。

但自从 ChatGPT 出现以来,教师的工作不再仅仅是教授课程和疲于奔命地督促每个学生完成作业。他们越来越需要兼任侦探和检察官的角色,因为那些缺乏学习动力的学生再也不能逃课了。他们几乎可以轻而易举地提交一份模拟作业。而且相当一部分学生确实这么做了——在大学理事会最近对 600 名高中生进行的一项调查中,84% 的学生表示他们曾使用生成式人工智能完成作业。

教师们当然对作弊并不陌生。但考试时偷看笔记或从维基百科抄袭段落,与被称为"法学硕士"(LLM)的大规模杀伤性武器相比,简直是小巫见大巫。我怀念那种非此即彼的简单问题,比如"作弊还是没作弊?"。现在,我却被迫在256种灰色地带中做出判断,并且还要提供充足的证据来捍卫我的决定,以防学生就我的评分向多级机构审查委员会提出申诉。

这项令人精疲力竭的工作不仅占用了我惊人的时间,还让我产生了一种不安的想法:即使是那些积极投入的学生,他们的真实水平也可能并非表面看起来那样。或许他们是因为我的帮助才理解了那些晦涩难懂的概念,又或许他们只是比我更熟练地复述了维基百科上的段落,而我却看不出来。

让我解释一下为什么在这种环境下学生损失最大,以及为什么像我这样的教师感到无力解决这个问题。

做或不做,没有人工智能。

学生常常对课程作业存在误解。他们可能把老师视为阻碍自己获得理想成绩的对手。他们认为"得到正确答案"才是教育的目标,因为只有这样才能确保拿到好成绩。

但这就像认为健美的目标仅仅是记录举重次数一样荒谬。举重的艰辛才是关键,因为它能带来实际的体能提升。一个常见的比喻是,用法学硕士学位来写论文就像开着叉车进健身房。没错,重量确实被举起来了,但却一无所获。

在最近一段关于 Sora 如何让用户轻松生成相对逼真但问题重重的视频的视频中,Hank Green 揉了揉眼睛,仿佛在对着 OpenAI 首席执行官 Sam Altman 大喊:“摩擦很重要,Sam!”

格林的这段话同样适用于描述学习过程。如果没有摩擦,没有努力,那就没有付出任何努力,学生也就学不到东西。他们就算去看油漆慢慢干,效率也不会比这低多少。

我的课程作业中有些问题需要批判性思考,才能将想法拓展到我所教授内容之外。例如,其中一道题要求学生通过思考一种无需等待多年才能让特定巨石风化侵蚀就能研究风蚀的方法,从而偶然发现“自然实验”的概念(这种实验的对照组与我们之前讨论的例子截然不同,例如医学试验中的安慰剂)。

我注意到一个变化,于是最近回顾了自 2019 年提出这个问题以来收到的全部 279 个答案。在 ChatGPT 出现之前,大约三分之一的答案能够成功解答,他们能够独立地将一些重要的知识点联系起来,进行科学思考,而不是被动地接受另一个事实。而过去两年,成功率已经攀升至一半以上。这其中并没有什么奥秘:ChatGPT 在回答这个问题时使用的术语现在出现频率很高。

学生们可能会认为这只是查找信息——大多数学生认为这是在调查中使用 LLM最有帮助和可接受的方式——但是输入问题并传达答案与思考问题是不一样的。

像这样的问题,我们称之为“形成性评价”。我从不评判答案的正确性,只看学生的努力程度。关键在于了解学生是否真正理解了核心概念,或者是否还需要一些帮助来建立联系。在风险较低的情况下(例如课堂的大部分时间),失败是学习过程中有益的一部分——如果在期末考试中遇到这个问题,情况就完全不同了。

如果课程中的形成性评估最终只是交给LLM系统完成,那设计这些评估还有什么意义呢?这样一来,对学生和教师来说都是浪费时间。小测验是很好的学习工具,可以帮助学生检验自己的理解程度——前提是学生愿意去做。现在,你只需一个简单的提示,就能让“智能”LLM浏览器自动完成整个课程的所有测验。

教师应该保留这类作业,让那些想要从中受益并接受作弊行为的学生完成,还是应该为了防止作弊而取消这种学习机会?

进化,自然选择

许多教师正试图通过回归那些几乎不受法学硕士影响的评估工具来适应这场危机——例如口试或在课堂上监督下完成的手写作业。这些解决方案对异步在线课程的教师来说都行不通。这很糟糕,因为这些课程的可用性至关重要。它们可以帮助残疾学生、居住在远离校园的农村地区的学生,以及那些一边全职工作或照顾家人一边攻读学位的学生。如果我们不得不放弃在线课程,那么这些学生将成为牺牲品。

但即使是面授课程,为了防止法学硕士考试作弊而采取的调整措施,往往也是降低教学质量的妥协。例如,耗时费力的口试并非仅仅因为师生比例失衡而消失。笔试(或键盘鼠标考试)更容易确保每位学生的考试体验一致,并减少评分中可能存在的偏见。

写作作业原本可能是极佳的教学工具,如今却成了最先被砍掉的环节。我以前在一门自然灾害课上,会让学生们为一部好莱坞大制作灾难片编写剧情大纲,既要运用真实可靠的物理原理,也要结合一些不切实际的理论。这对他们的写作能力大有裨益;学生们乐在其中,而且这还迫使他们巧妙地运用所学知识。

但法学硕士生们却能在短短十秒钟内写出一篇这样的作文。虽然这些作弊行为很容易识别(而且质量很差),但这项作业已经变得难以完成。我批改一篇真正的学生作文只需要15到30分钟,但处理每一篇作弊文章却要花费四到八个小时,这令人沮丧又压抑。所以我不得不把它从课程中移除。

过去,当教师们抱怨抄袭问题时,他们常常(有时带着居高临下的语气)被告知,或许他们应该尝试布置高质量的作业,而不是那些只需简单复制粘贴就能轻松完成的作业。与其让学生定义术语或总结概念(维基百科就在眼前),不如给他们布置更高层次的任务——例如,评估问题的不同解决方案,或者反思该概念在他们自身生活中是如何体现的。高质量的作业会更有趣,也更难作弊。

但现在,让 ChatGPT 假装反思与让它定义术语一样简单。这两件事都比抄袭维基百科容易得多!而且,按照我们传统的作弊标准,这一切都很难被起诉,因为目前还没有无可辩驳的 LLM 使用测试方法。(这有利有弊——这也意味着,被错误指控的无辜学生往往无法证明自己是诚实完成的。)

我并非唯一对此困境感到恼火的人。一项针对约3000名大学教师的调查显示,85%的教师认为法学硕士“会降低学生培养批判性思维能力的可能性”,72%的教师表示在管理法学硕士的使用方面存在挑战。

不出所料,高等教育管理者们——他们正忙着签署机构LLM订阅合同,以展示他们面向未来的思想领导力——的回应是告诉教师,他们的工作是教学生“如何有效地使用人工智能”。

这种“有效利用”的大多数例子都涉及学生用人工智能生成文章,然后再进行评论。(仿佛互联网上还不够多的人类写作作品可供评论似的!)每次我问老师布置这项作业的教学目标是什么时,他们的回答都是帮助学生明白为什么不应该让法学硕士代笔。如果你们发现这与校方的意愿之间存在矛盾,请随时打断我。

即使你发现一些富有创意且结构严谨的活动,其中的指导原则引导学生在课堂上进行与课程相关的学习,问题仍然存在:LLM在一天中的其他 23 个小时里对这些学生产生了什么影响?

教师们之所以感觉这次与以往的技术恐慌截然不同,是因为人工智能几乎正在破坏教育的方方面面,而目前还没有明确的解决方案。这就像一场怪异的游戏:你试图让学生去做你认为对他们的学习有益的事情,而他们却拿着法学硕士学位(LLM)来指责你,而且很多时候,唯一的制胜之道似乎就是不参与其中。

没有施工的干扰

教师们对现状感到厌倦,不得不忍受一连串老生常谈。这就是未来,最好习惯一下!伟大的时间旅行者啊,您至少能给我几个好的彩票号码吗?卢德分子曾经说过我们不应该使用计算器!您指的是数学老师现在在教授许多技能时限制使用计算器(值得注意的是,计算器不会凭空给出错误答案)的做法吗?法学硕士是私人导师!您会聘请一位玩“两真一假”游戏的导师吗?

似乎没人愿意听老师们解释在这种毁灭性的教育反物质面前工作有多么糟糕。相反,我们却被提供了人工智能评分工具,用来给人工智能生成的作业打分。

或许像我这样的批评者根本不了解人工智能革命(不管它到底是什么),但我们都了解人性,也熟悉学生们惯用的套路。法学硕士是条捷径。学生们常常走捷径,之后却后悔莫及。我们都经历过这种情况。

作为一名教师,我希望为学生们铺设一条清晰的登山路线,并见证他们最终登顶。然而,我却越来越感觉自己像是在进行一场不可能完成的防守,竭力阻止他们偏离正轨。这让我精疲力竭,而且我大多时候都会失败,这意味着我根本帮不上他们什么忙。学生们确实渴望攀登高峰,但他们总是忍不住想要跳过一些难关。

几个月前,我无意中听到几个大学生在谈论他们的课程。一个学生抱怨说,他当晚有个作业要做,另一个学生难以置信地问,为什么不直接让 ChatGPT 代劳呢?第一个学生回答说:“这是我的专业,我这门课真的需要学习东西。我在其他课程里都用人工智能。”

尽管大学管理者和法学硕士项目宣传试图营造一种假象,但我从未遇到过任何学生认为让法学硕士(LLM)替他们完成作业就能学到东西。对他们来说,这只不过是工作量管理而已。

谁也无法预料人工智能泡沫破裂后会发生什么,届时,便捷普及的法学硕士(LLM)资源将大幅缩减,变得难以获取。但人工智能虽然存在,却并未革新教育、提升学习效果,反而让那些长期以来帮助学生学习的方法变得异常困难。

评论

0 条登录后才可以发表评论。

立即登录