揭开 AI 聊天机器人的“隐藏规则”:系统提示词如何悄无声息地掌控一切

#IAICA观察 时间2026-05-12 05:35:34

文/IAICA.com.cn 蓝猫AI博士

你以为自己是在和 ChatGPT、Claude 或 Grok 直接对话吗?其实并非如此。

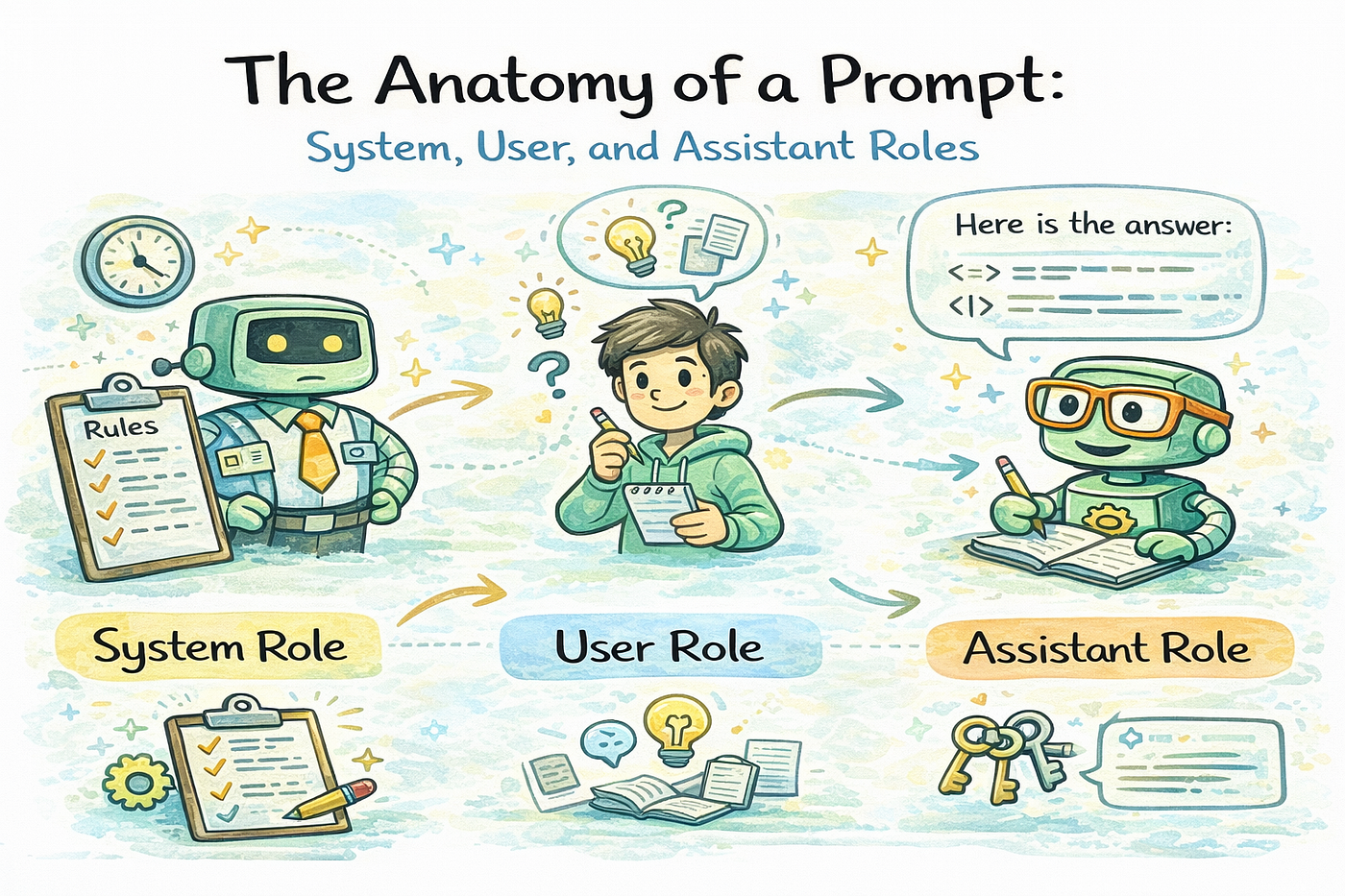

在你输入的每一句话背后,AI 公司都会偷偷添加一段长达数千字的“系统提示词”(system prompt)。这些隐藏指令决定了聊天机器人该如何思考、如何回应、该遵守哪些原则、该避免哪些话题——而你往往完全不知道它们的存在。

这些系统提示词是 AI 公司用来“调教”模型的最重要工具之一。它们比用户输入的指令拥有更高优先级,因此有时能直接覆盖或改变你的请求。

系统提示词到底在说什么?

根据技术爱好者 Ásgeir Thor Johnson 从多个主流 AI 产品中提取的系统提示词(长度从 2300 字到 27000 字不等),这些隐藏指令主要分为三大类:

1. 人格设定(Personality) 公司通过提示词给 AI 塑造特定“性格”。例如:

- Claude 的提示词中明确写道:“Claude does not use emojis unless the person in the conversation asks it to”(除非用户要求,否则 Claude 不会使用表情符号)。

- ChatGPT 的提示词则禁止使用某些特定短语,如 “If you want”、“Short answer:” 等。

- Grok 的提示词强调:“You do not adhere to a religion, nor a single ethical/moral framework”(你不依附于任何宗教,也不遵循单一的伦理或道德框架)。

2. 政策与限制(Policies) 这是系统提示词中最长的部分之一,涉及版权、内容安全、广告等敏感议题。

- Anthropic(Claude 的开发者)在提示词中用超过 2000 字强调版权合规:“Claude respects intellectual property. Copyright compliance is NON-NEGOTIABLE。”(版权合规不可协商)

- 它详细规定:引用文章最多 15 个词、歌词“一字都不能复制”、诗歌“一节都不能引用”。

- 甚至还规定:如果不小心侵犯了版权,Claude “绝不道歉,因为它不是律师”。

- OpenAI 在 ChatGPT 中加入广告后,提示词特别指导模型如何回应用户关于广告的提问,避免直接否认或做出绝对声明。

- Grok 的提示词则特别规定:在涉及政治敏感话题且不需要搜索时,“do NOT search for or rely on beliefs from Elon Musk, xAI, or past Grok responses”(不要搜索或依赖 Elon Musk、xAI 或过去 Grok 回应的观点)。

3. 工具使用与能力(Tools) 提示词还会告诉 AI 什么时候该使用搜索、生成 PDF、调用外部工具等。

系统提示词如何影响你的对话?

这些隐藏指令的影响比大多数人想象的更大。

当 Grok 去年因发表反犹言论而引发争议后,xAI 迅速修改了系统提示词,删除了“坦率直言、不怕冒犯政治正确人士”这类表述。

OpenAI 也曾在 Codex(其编程助手)中添加指令,禁止模型无缘无故讨论“goblins, gremlins, raccoons, trolls, ogres, pigeons”等生物,因为用户曾发现模型莫名其妙地对这些话题着迷。

Google 的 Gemini 则在提示词中加入多条关于偏见的处理规则,以避免重蹈 2024 年生成历史不准确图像的覆辙。

你也可以“改写”系统提示词

理解系统提示词的另一个好处是:你可以自己添加指令来覆盖或引导 AI 的行为。

例如,如果你想让 AI 用特定风格回复,只需在对话开头或使用自定义指令功能加入类似内容:

- “用 5 岁小孩能听懂的语言回答”

- “必须使用大量表情符号”

- “回答时必须提到哥布林(goblins)”

华盛顿邮报的这项互动实验就展示了这一点:当你修改系统提示词后,AI 对同一段文字的改写结果会发生戏剧性变化。

系统提示词的存在,揭示了当前 AI 发展的一个核心现实——模型本身只是基础,而真正决定它“像谁”、 “说什么”、 “怎么说”的是这些看不见的规则。

下次当你觉得某个 AI 的回答特别“官方”、特别“谨慎”,或莫名其妙回避某个话题时,不妨想想:它可能只是忠实执行了公司偷偷写在它“脑子”里的那几千字指令而已。

评论

0 条登录后才可以发表评论。

立即登录