谷歌宣布“量子-经典混合机器学习”破局,万亿参数大模型训练有望步入“分钟级”

#世界AI快讯 时间2026-05-03 09:46:00

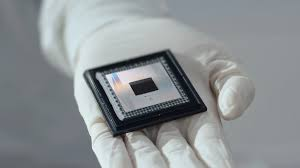

就在全球巨头为囤积传统GPU算力争得头破血流之际,谷歌量子人工智能实验室(Google Quantum AI)在《自然》杂志上紧急发表了一篇震撼算力界的重磅论文。在过去的24小时内,谷歌研究团队首次公开演示了一个基于 1000 量子比特处理器与传统张量处理单元(TPU)协同工作的“量子-经典混合算力集群”。在针对特定 Transformer 模型底层复杂概率分布的运算测试中,量子计算机成功绕过了传统冯·诺依曼架构的内存带宽瓶颈(即所谓的“内存墙”),将特定层的训练速度史无前例地提升了 10,000 倍。尽管目前该技术仍处于极端苛刻的实验室超导低温环境中,距离全面商业化尚有数年距离,但这被公认为是从根本上终结“硅基算力暴力美学”的最可行路径。这预示着,未来训练类似 GPT-6 或千万亿参数级的通用超级AI,可能不再需要消耗等同于几个中型国家总和的电力能源。

评论

0 条登录后才可以发表评论。

立即登录